AI Code Assistant — Interface Web IA Locale Style Claude

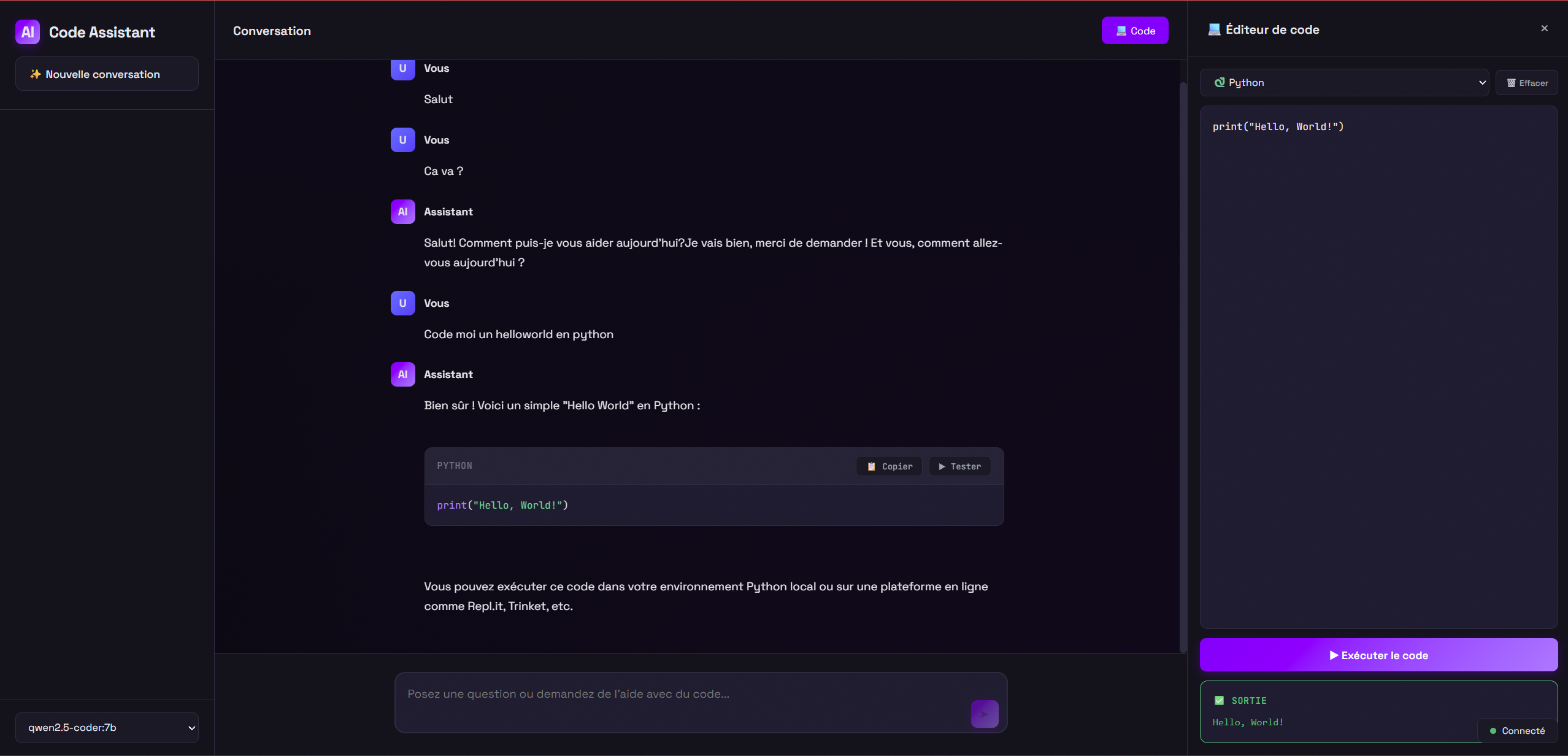

Interface web locale complète pour l'assistance au développement : chat IA en temps réel via WebSocket, éditeur de code avec exécution Python, streaming de réponses et support multi-modèles Ollama.

Galerie

Problématique

Disposer d'un assistant IA de développement local, privé, rapide et personnalisable, sans dépendance à un service cloud ou exposition de code source.

Solution apportée

Backend FastAPI + Ollama avec streaming WebSocket, sandbox d'exécution Python sécurisé et frontend React inspiré du design de Claude, tournant entièrement en local sur GPU NVIDIA.

Description du projet

Projet personnel visant à créer une alternative locale à Claude.ai pour l'assistance au développement, tournant entièrement sur ma machine sans envoyer de données à des serveurs externes.

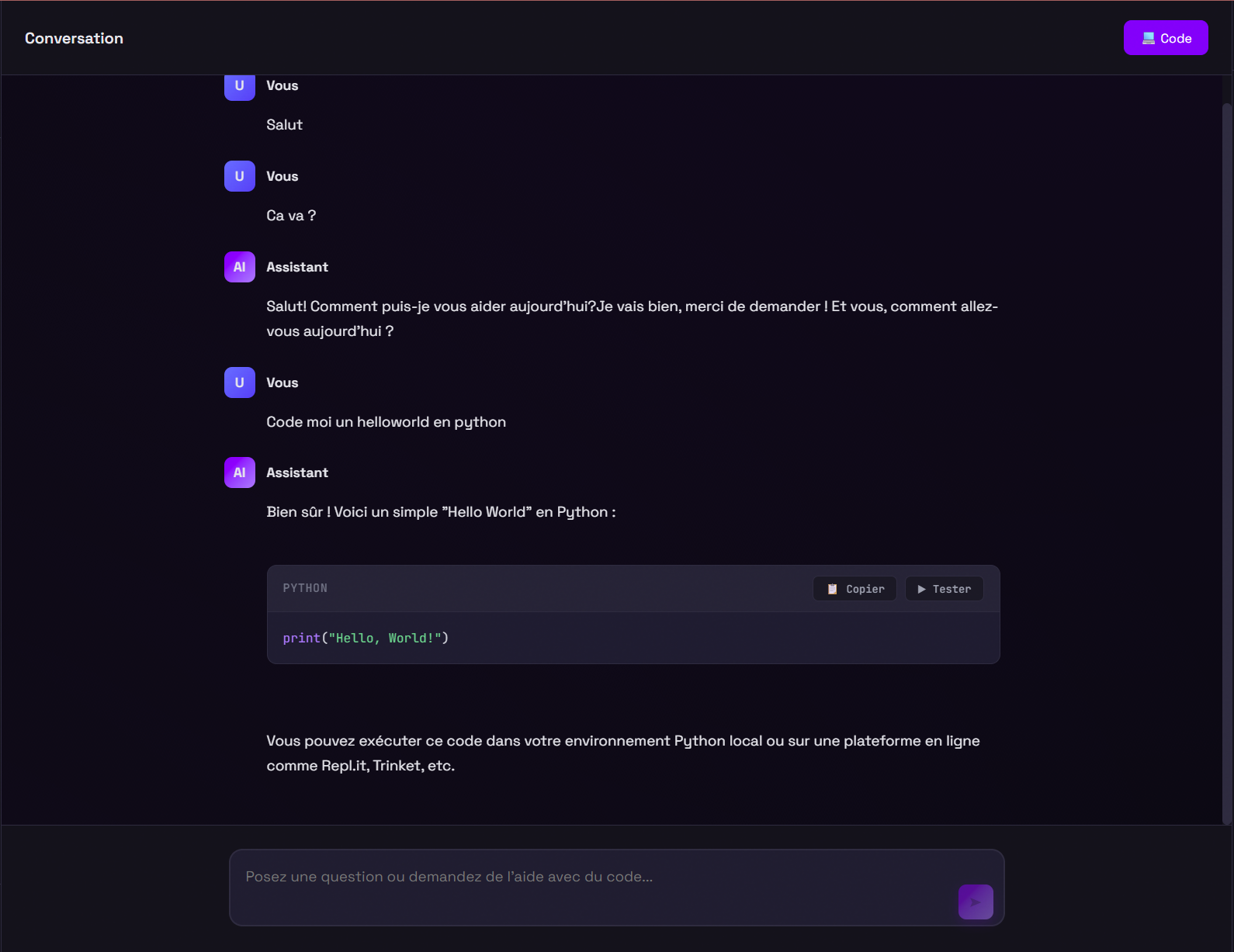

Le backend FastAPI gère deux canaux de communication : une API REST pour les requêtes simples et un WebSocket pour le streaming des réponses en temps réel. L'intégration Ollama permet de sélectionner différents modèles (qwen2.5-coder:7b, code-expert) selon les besoins. Un sandbox d'exécution Python permet de lancer du code directement depuis l'interface et d'en voir les résultats.

Le frontend est une SPA (Single Page Application) React 18 avec hooks, incluant un historique de conversations, une coloration syntaxique du code et une interface soignée inspirée du design Claude. L'ensemble est déployé sur WSL2 avec NVIDIA GPU pour accélérer l'inférence des modèles.

Résultat

Assistant de développement local fonctionnel avec latence faible (GPU local), support de plusieurs modèles, exécution de code intégrée et interface moderne.